�ȸ��Ƴ����MAI���� �ɿ����R�e��ͯ��Ű���DƬ

�������գ��ȸ�l��һ��AI���˹����ܣ����ߣ��Ɏ��������ˆT�����R�e��ͯ��Ű����CSAM�����ݣ��Ķ���ֹ�@Щ�D���ھW�ϡ��ȸ�Q���@��AI���߲��H�ɻ������еĔ��������Y�ό��ȣ�߀�ܘ�ӛ�°l�F�ĈDƬ���@��ζ������������Ű���ă�ͯ�п��ܸ��챻�R�e�������������Mһ��Ű����

����9��3�գ��ڹȸ蹤������Nikola Todorovic�ͮaƷ����Abhi Chaudhuri�l����һƪ�������ᵽ����һ헌���У�ԓ���߿Ɏ��������ˆT��ͬһ�r�g�ȣ��ҵ�����������ă�ͯ��Ű�����ݣ��R�eЧ��������700%��

�������ϣ��ȸ��2006����_ʼ���@��о���2008�꣬�ȸ��_ʼʹ��“��ϣ���g”���ַQɢ�м��g����ָ��һ�������M���s�ۣ�ݔ����һ�ι̶��L�ȵĔ����������@�Δ�����“ָ�y”�����ӛ��֪�ă�ͯ��Ű���D���Ա��R�e�؏͈D�� ÿ���`Ҏ�D��������һ���Լ���ID���o�����۲鿴��Ӌ��C�����R�e��

����2013�꣬�ȸ�Lԇ����ͯ��Ű���D��ļ���“ָ�y”���ϵ����ИI�������У�������I���̷����T�ʹ��ƙC�����õ��ڙz�y�̈́h����ͯ��Ű���D����f�����Ķ����Ʒ��

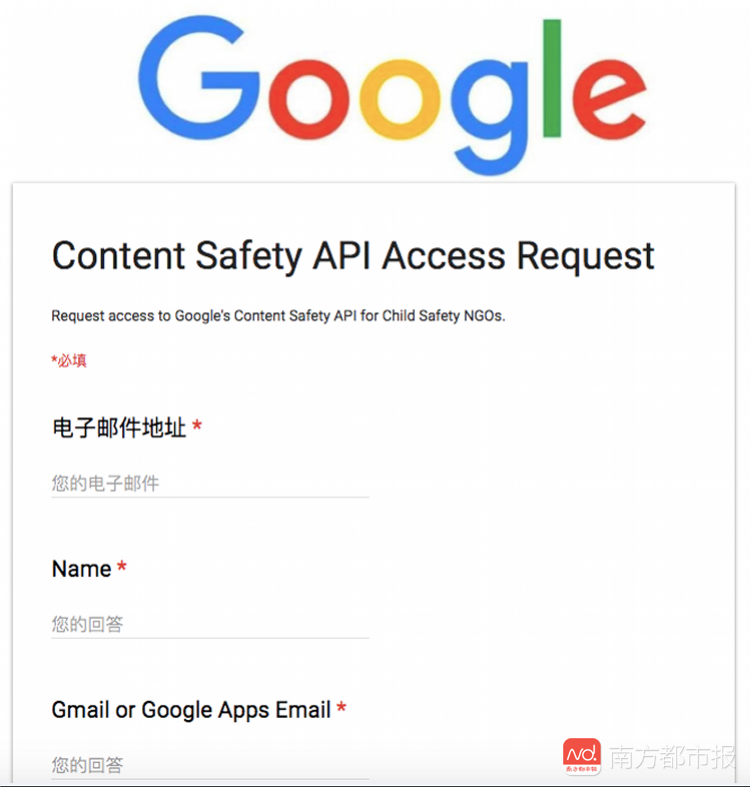

�������չȸ��Ƴ��ă��ݰ�ȫAPI�t�ǽY������ǰ�ص�AI���g�������ڬF�м��g�Ļ��A�ϴ�Ҏģ�����R�eЧ�ʡ�ͨ�^����W�j���g�ڈD���R�e�ϵđ��ã��@��API���ԃ��ȳʬF���п����ǃ�ͯ��Ű�������ĈD�����⣬�c��ǰֻ���c�ѱ���ӛ�郺ͯ��Ű���ĈD��ͬ���@��API߀�����R�e����ǰ�]�б���ӛ�ĈD��

�����ȸ跽���ʾ���@��API�����M�ṩ�oNGO���ǠI���M�������ИI�������ʹ�á��[˽�o�l���ԓAPI�L��Ո����濴������Ո�����ṩ����������]�����M�����Q���Ŀ��������Ϣ��

�������ڹȸ��Ƴ���AI���ߣ����W�^��������ʾ�gӭ���@��һ�������ڃ�ͯ��Ű�������ھ��Ĵ��ͽM������ʮ�ׂ������\�I�Ñ��e��W�j����ƸՈ���ˈFꠌ��T�R�e�ʹ��CSAM���ݡ�

�������W�^��������ϯ���й�Susie Hargreaves OBE��ʾ���@��AI���߿��Ԏ������Ҹ���Ҏģ�،�����ϣ�����ǰδ����ӛ��Ƿ����ϵĈD������Ŀ�ˣ��Ķ���߃�ͯ��Ű�����ݵ��R�e�ٶȣ������Ϸ����ߵIJ�����ʹ���W�ɞ����ȫ�ĵط���